우사이먼 교수 연구실 (DASH Lab) ICCV 2023 논문 게재 승인

- 인공지능학과

- 조회수1720

- 2023-07-28

DASH Lab의 우사이먼 교수와 소프트웨어학과 박사과정 Binh M. Le의 논문이 컴퓨터 비전 분야의 최우수 국제 학술대회인 IEEE/CVF International Conference on computer Vision (ICCV)에 게재 승인되었습니다. 논문은 2023년 10월 프랑스 파리에서 발표될 예정입니다.

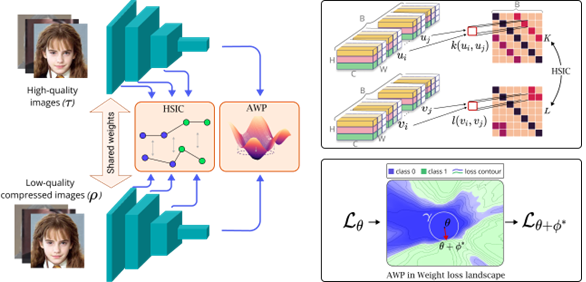

현재 딥페이크(Deep + Fake)를 활용한 사회적 악용사례 및 범죄는 점차 늘고 있는 추세이며, 딥페이크 탐지 관련 많은 연구가 진행되고 있지만, 저화질 딥페이크 이미지는 정보량이 적어 고화질 이미지에 비해 탐지가 훨씬 더 어렵고, 성능이 높은 일반화된 탐지모델을 만드는 것은 challenging합니다. 이 연구에서 다양한 화질의 딥페이크 이미지를 동시에 효율적으로 탐지할 수 있는 Quality Agonistic Deepfake 탐지 모델을 제안합니다. 이는 고화질과 저화질 딥페이크를 Hilbert-Schmidt Independence Criterion (HSIC)를 이용한 intermediate representations간 기하학적 유사성을 극대화함으로서 다양한 input corruption하의 강건함을 증가시켜 모델의 일반성을 높여 좋은 다양한 벤치마크 데이터셋에 최고의 성능을 보여 주었습니다.

[Abstract] Deepfake has recently raised a plethora of societal concerns over its possible security threats and dissemination of fake information. Much research on deepfake detection has been undertaken. However, detecting low quality as well as simultaneously detecting different qualities of deepfakes still remains a grave challenge. Most SOTA approaches are limited by using a single specific model for detecting certain deepfake video quality type. When constructing multiple models with prior information about video quality, this kind of strategy incurs significant computational cost, as well as model and training data overhead. Further, it cannot be scalable and practical to deploy in real-world settings. In this work, we propose a universal intra-model collaborative learning framework to enable the effective and simultaneous detection of different quality of deepfakes. That is, our approach is the quality-agnostic deepfake detection method, dubbed QAD. In particular, by observing the upper bound of general error expectation, we maximize the dependency between intermediate representations of images from different quality levels via Hilbert-Schmidt Independence Criterion. In addition, an Adversarial Weight Perturbation module is carefully devised to enable the model to be more robust against image corruption while boosting the overall model's performance. Extensive experiments over seven popular deepfake datasets demonstrate the superiority of our QAD model over prior SOTA benchmarks.

Contact for Questions: swoo@g.skku.edu